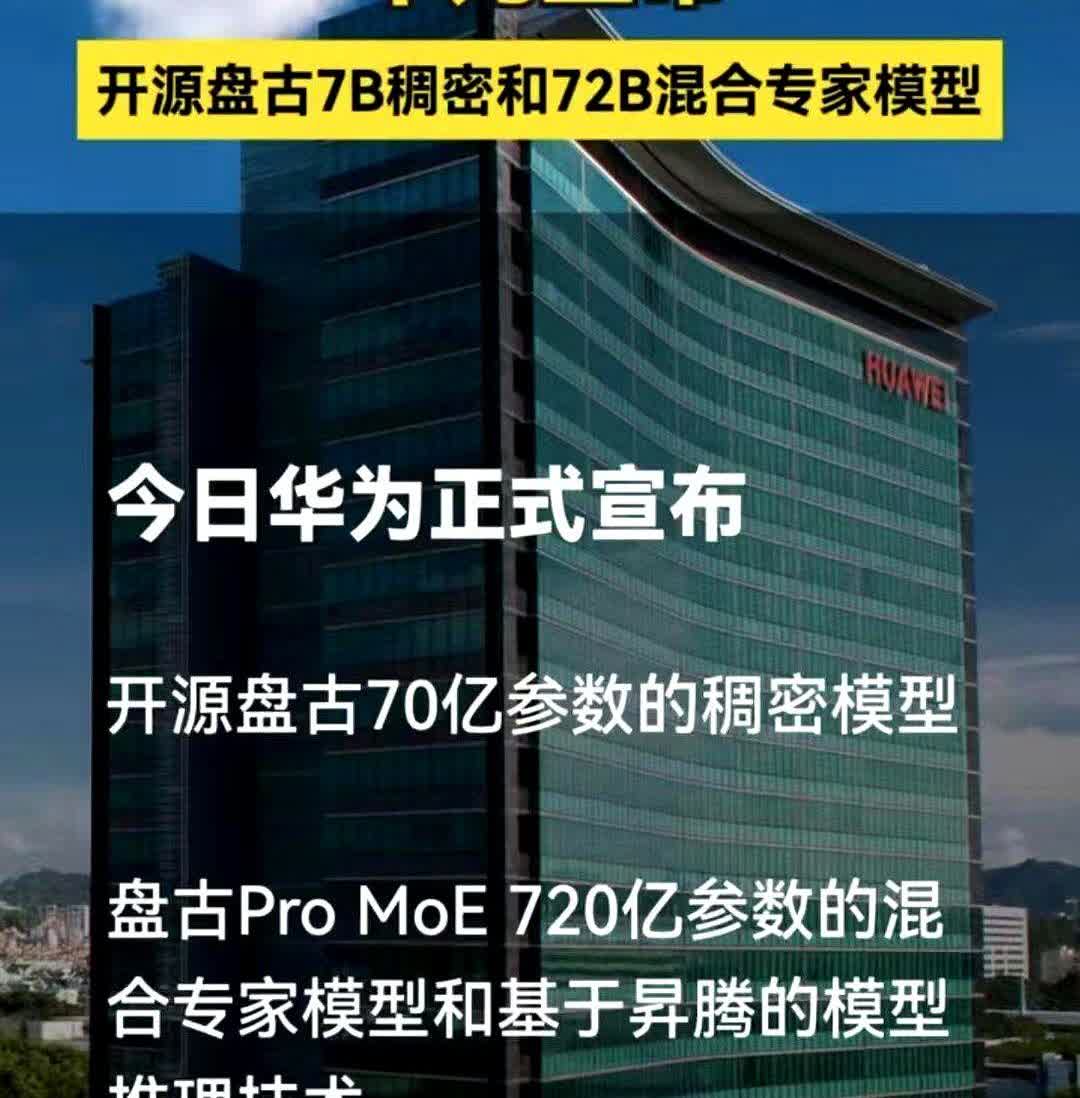

🎉 华为重磅发布开源大模型 🚀 华为近日宣布推出其第一个开源大模型——“盘古 Pro MoE”(含 720 亿参数)和“盘古 Embedded 7B”(含 70 亿参数)。 盘古 Pro MoE 参数量: 720 亿 训练设备: 4000 颗昇腾 NPU 性能亮点: 在多个基准测试中超越主流模型如 Qwen3-32B 单推理吞吐量高达 1528 tokens/s 盘古 Embedded 7B 参数量: 70 亿 创新功能: 引入“快思考”和“慢思考”双系统,提升推理效率 在复杂问题处理上优于 Qwen3-8B 🔥 这些模型的发布无疑为人工智能领域带来了新的突破!华为持续推动 AI 技术的发展,值得我们期待更多!😊