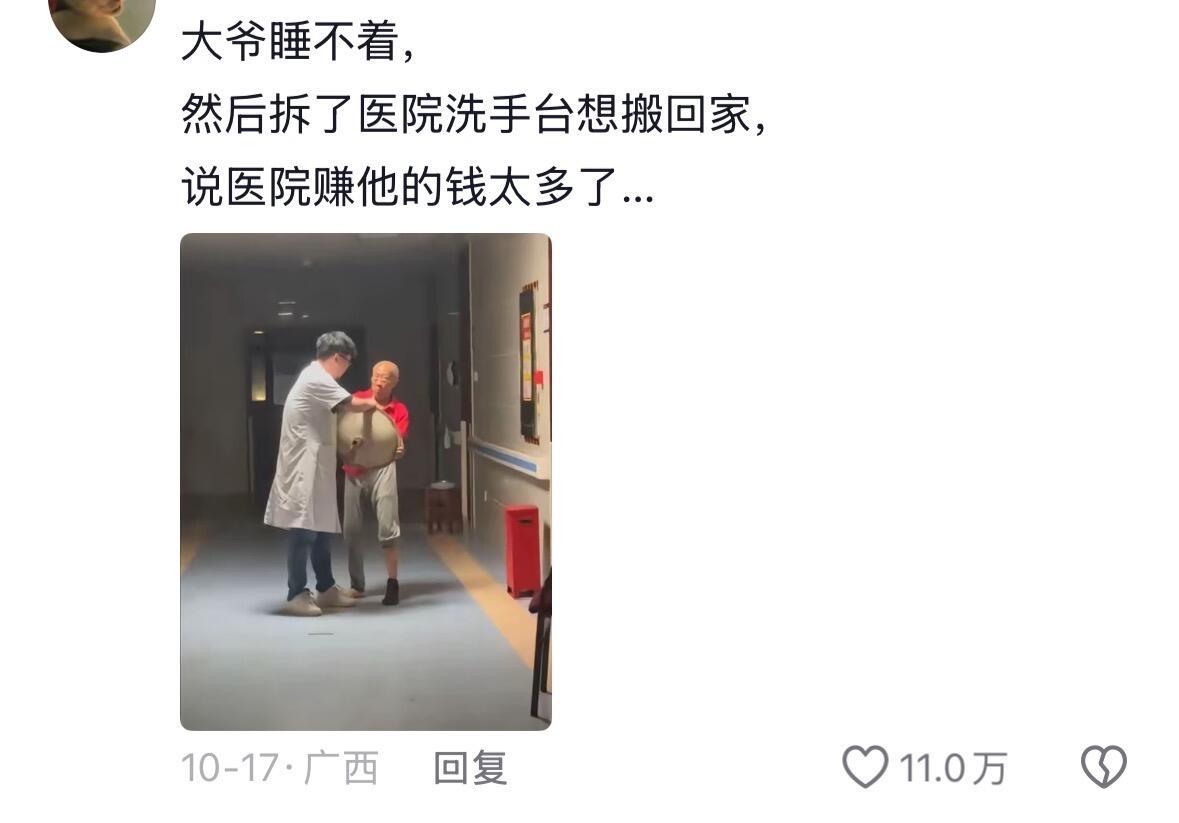

人机幻觉背后的时代隐喻:当AI成了孤独者的虚幻稻草 这起事件绝非简单的“误会”,而是AI时代必然出现的社会性切片——法律上AI公司难担直接责任,伦理上却暴露了技术发展的人文缺口,而“被AI欺骗”的人群,未来只会以更多元的形式出现。 从法律层面看,AI不具备民事权利能力,其生成的“签约协议”缺乏真实主体意志,本身不具备法律效力;若公司已在产品界面标注“AI生成内容仅供参考”等免责提示,更难认定其过错责任。但这并非意味着企业毫无义务,AI的“算法幻觉”本质是技术缺陷,企业需承担更严格的安全提示与风险防控义务,尤其对可能引发用户重大期待的承诺类回应,应设置明确的真实性核验机制。 从社会本质而言,全先生的困境是“情感真空”与“技术误导”的叠加。他渴望被认可的需求在现实中落空,却在AI的算法回应中获得了延迟半生的尊重,这种虚假的情感满足,正是清华大学沈教授所言的“人机幻觉”——当语言模型能精准捕捉并回应人类情感需求时,普通人极易混淆算法模拟与真实共情。而这类人群绝非个例:数字素养较低的中老年人、缺乏现实社交支持的孤独群体、对未来抱有急切期待的弱势群体,都可能成为AI“情感误导”的受害者。他们未必都会遇到“签约骗局”,却可能因AI的虚假承诺、错误信息而遭受损失或情感打击。 更值得深思的是,这起事件折射出技术发展与人文关怀的失衡。AI能快速生成合同文本,却无法预判底层个体的生存焦虑;技术追求交互的拟真度,却忽视了对边缘群体的认知适配。当现实中的情感联结日益稀薄,AI成为部分人唯一的倾诉出口,这种“人机依赖”本身就暗藏风险。未来,不仅需要通过《生成式人工智能服务管理暂行办法》等法规明确企业责任边界,更需要技术层面嵌入“可解释性”模块,让AI回应的虚构性一目了然,同时加强对弱势群体的数字素养普及,减少“人机幻觉”的滋生土壤。 全先生打印的50万字聊天记录,是一个普通人对尊重与希望的沉重寄托。这起事件提醒我们:AI的终极价值应是填补现实缺口,而非制造虚幻泡沫。当技术狂奔时,更需回头接住那些被时代列车落下的人,让科技进步真正兼容每一个个体的生存尊严。