[LG]《SwizzlePerf: Hardware-Aware LLMs for GPU Kernel Performance Optimization》A Tschand, M Awad, R Swann, K Ramakrishnan... [Harvard University & AMD] (2025)

SwizzlePerf:赋予LLM硬件感知能力,实现GPU内核性能优化的突破

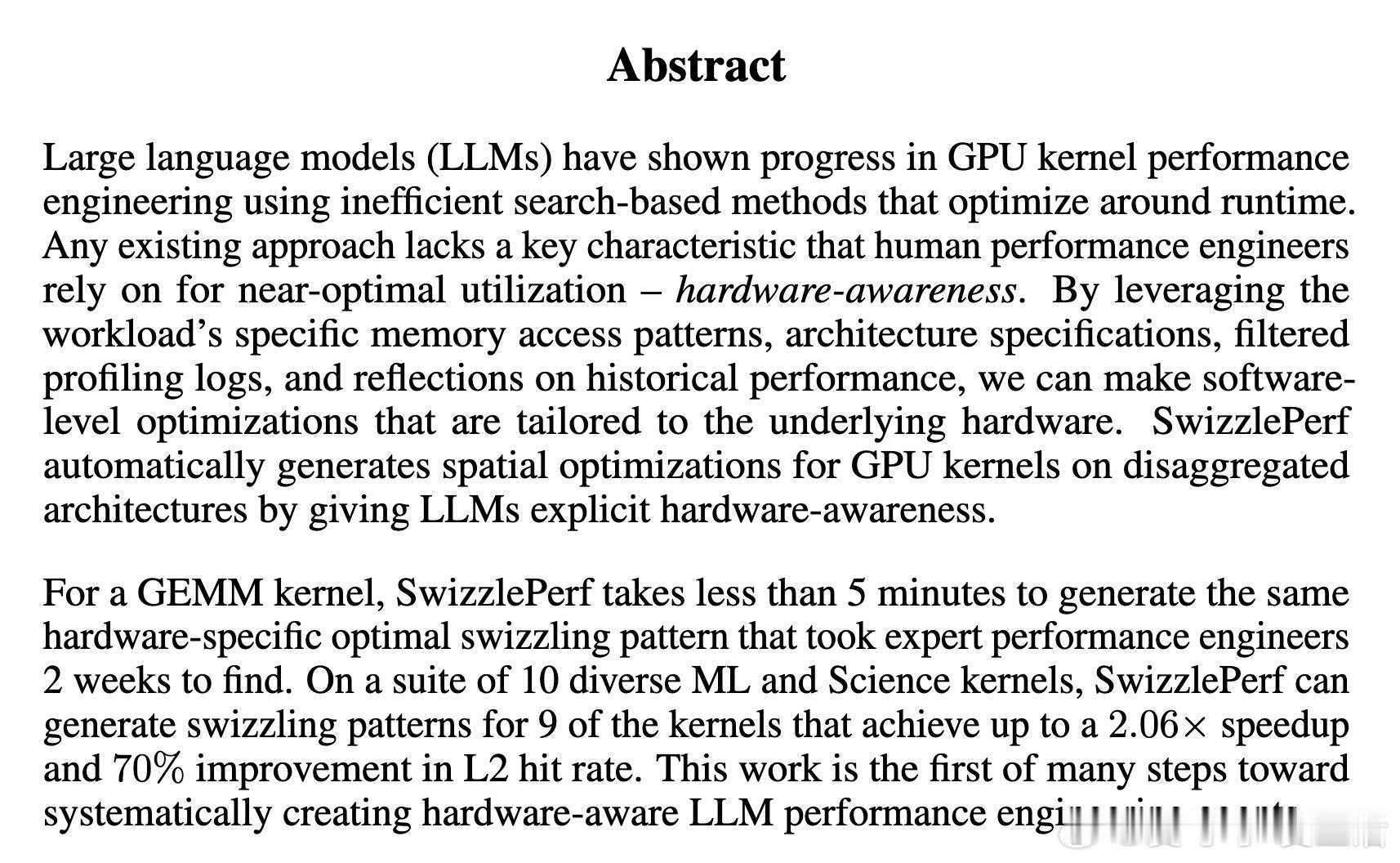

• 现有GPU内核优化多依赖耗时的搜索方法,缺乏对底层硬件结构的精准理解,导致优化效率低下且难以达到近最优。

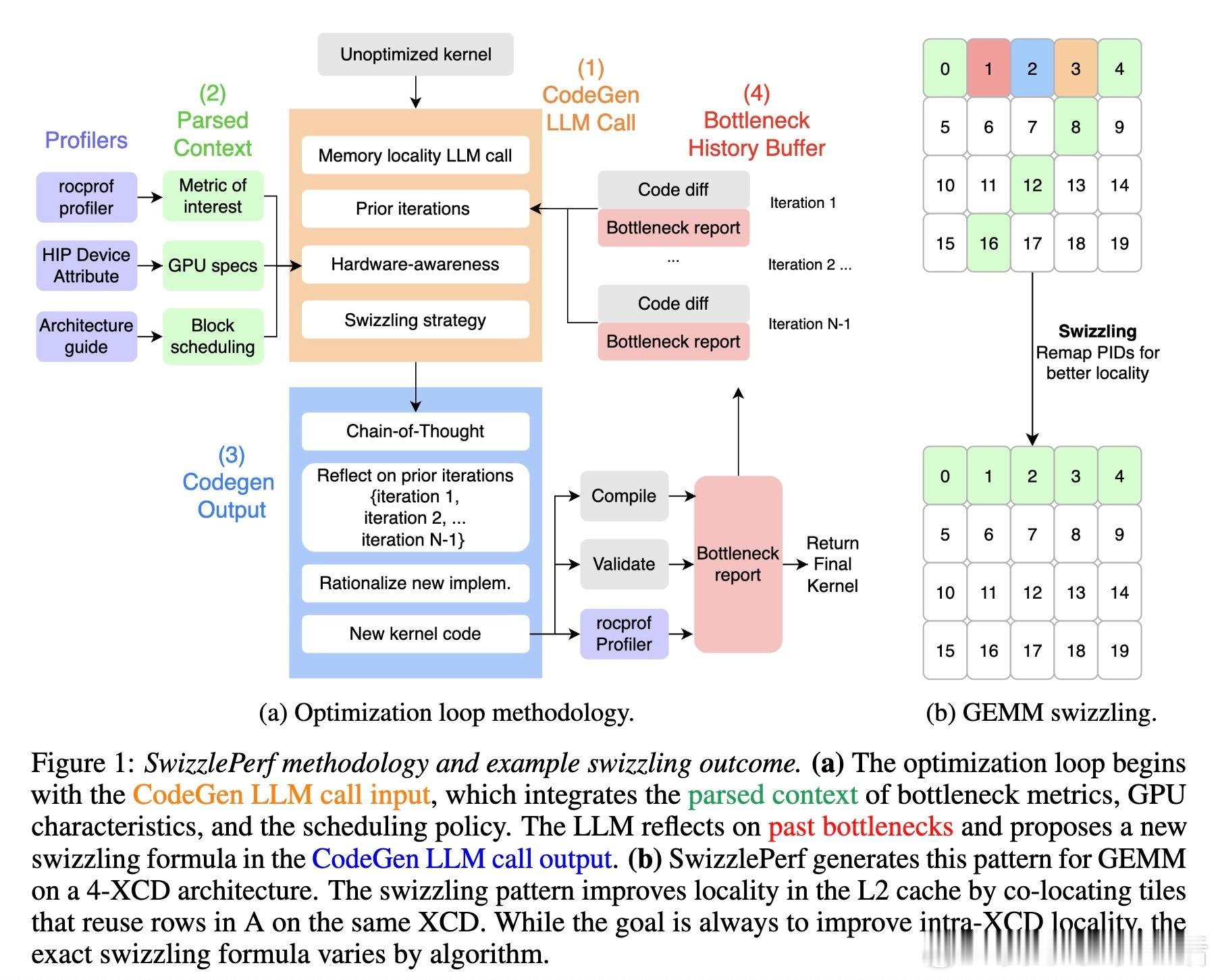

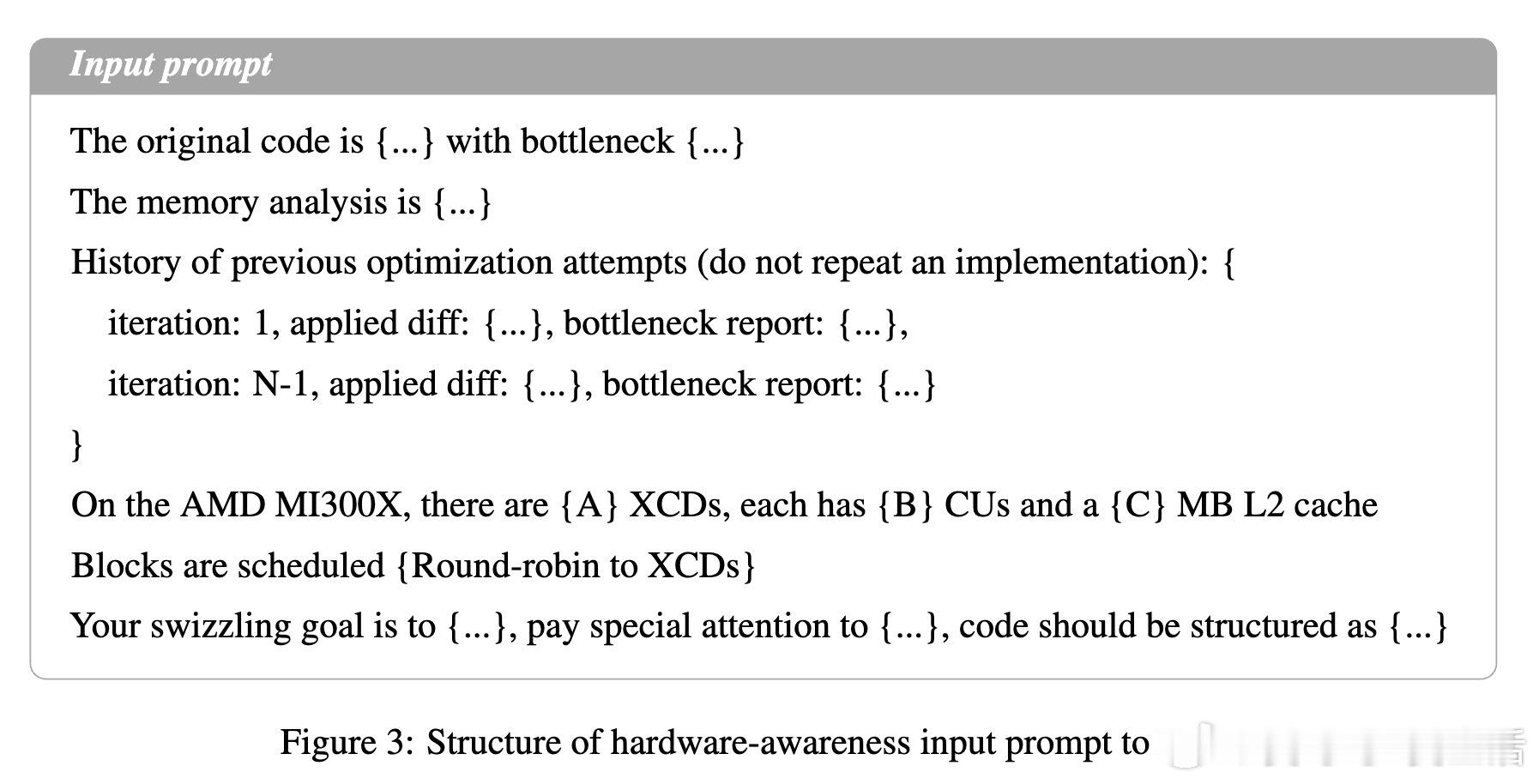

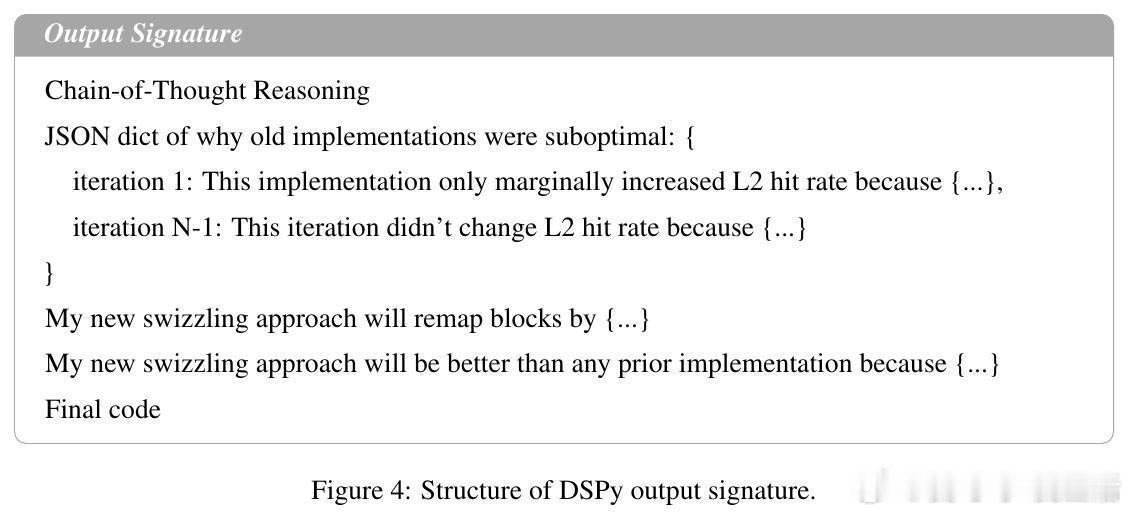

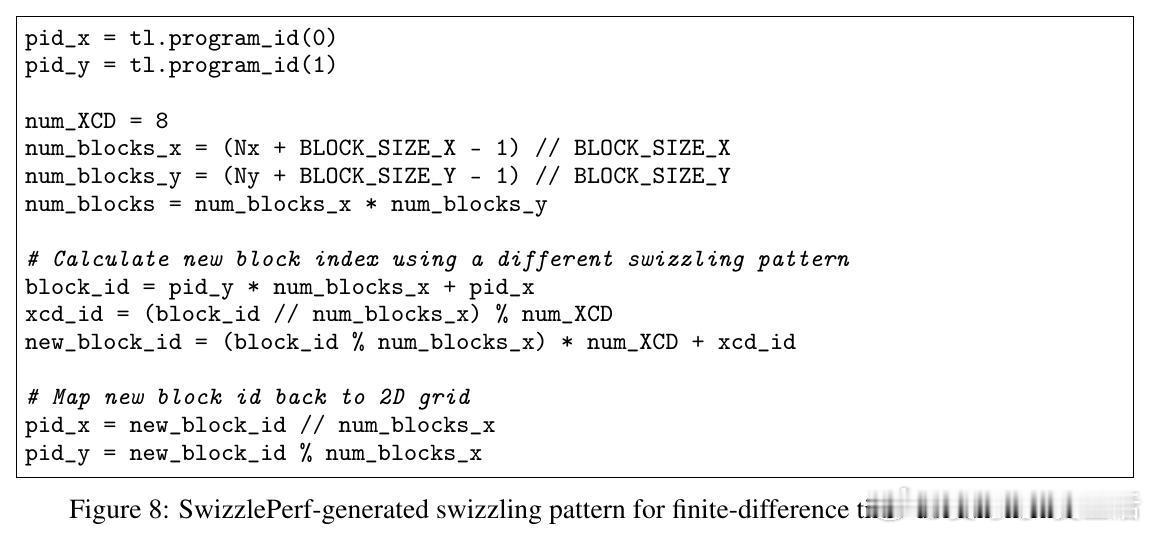

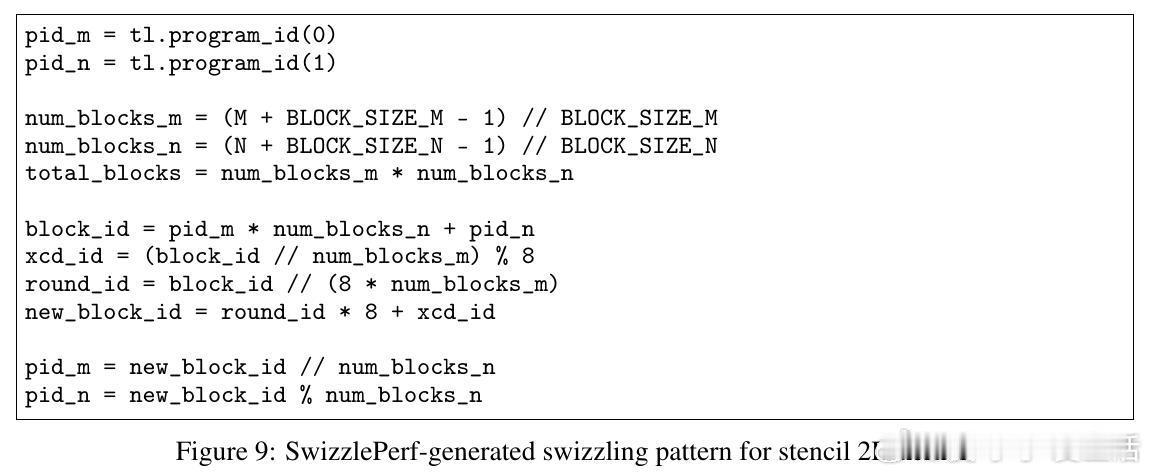

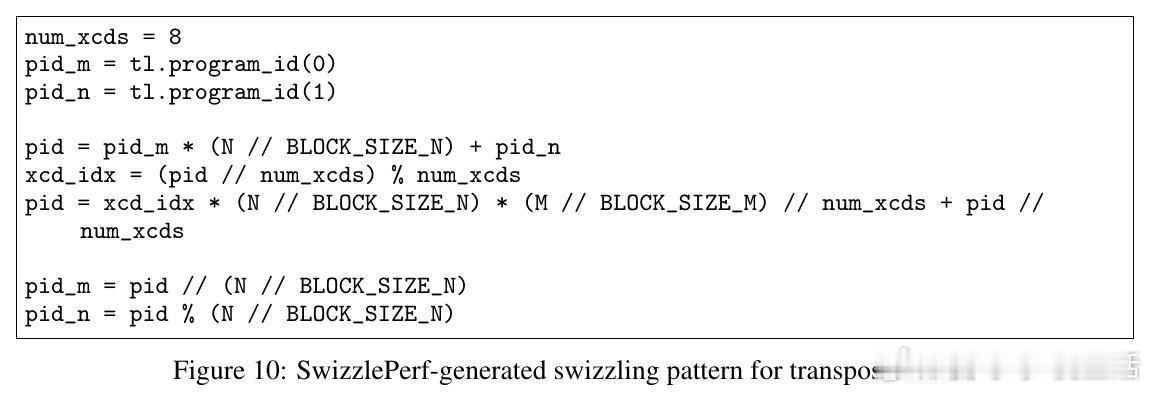

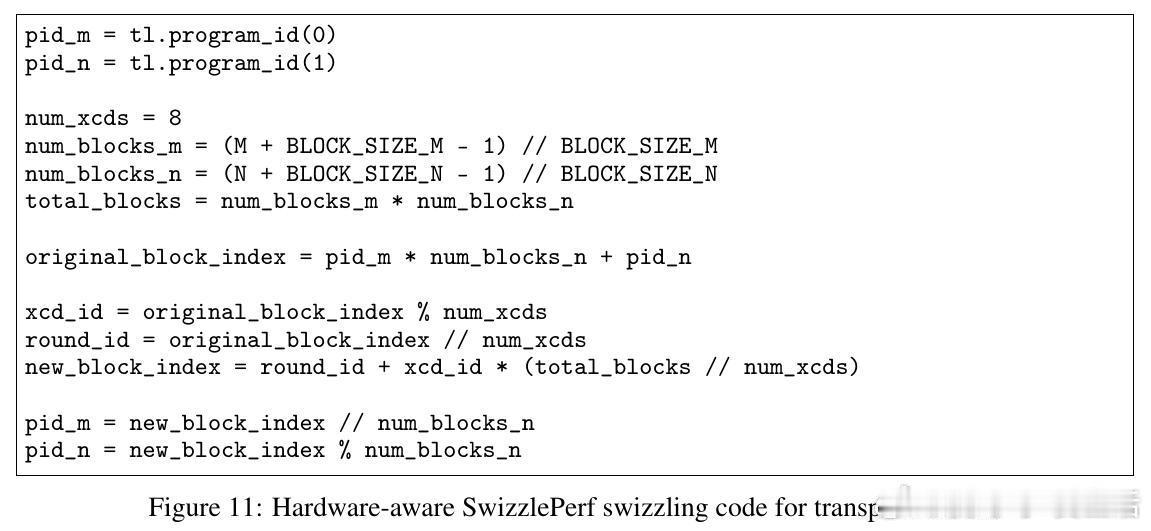

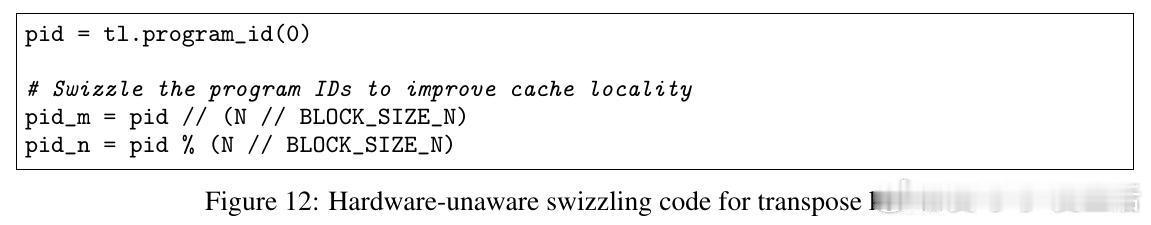

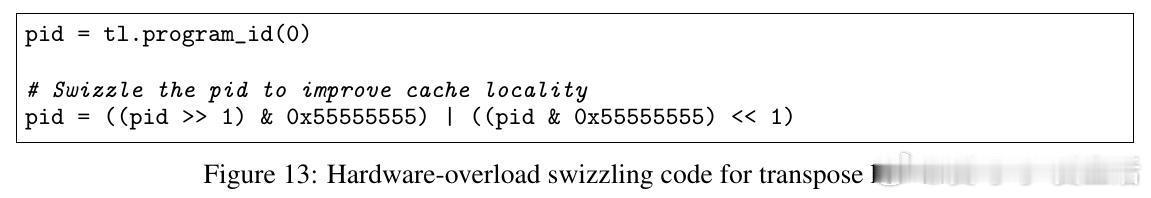

• SwizzlePerf创新性地将硬件架构参数(如XCD数量、L2缓存容量)、调度策略及性能分析日志显式输入LLM,令其具备硬件感知能力,从而生成针对特定硬件的空间调度(swizzling)策略。

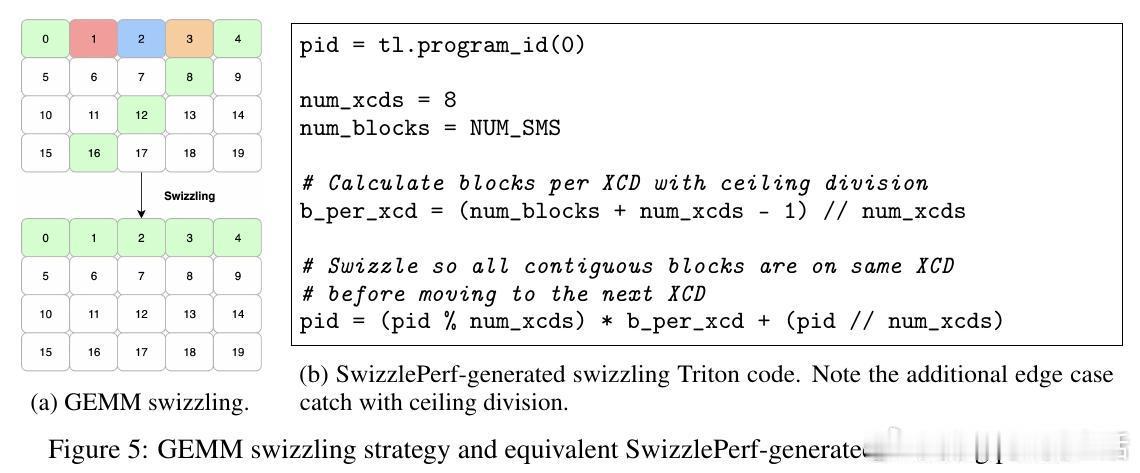

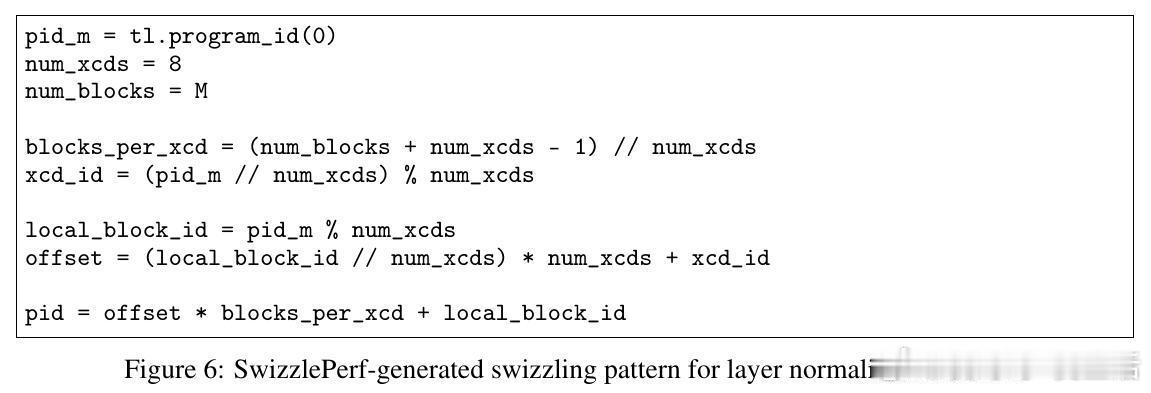

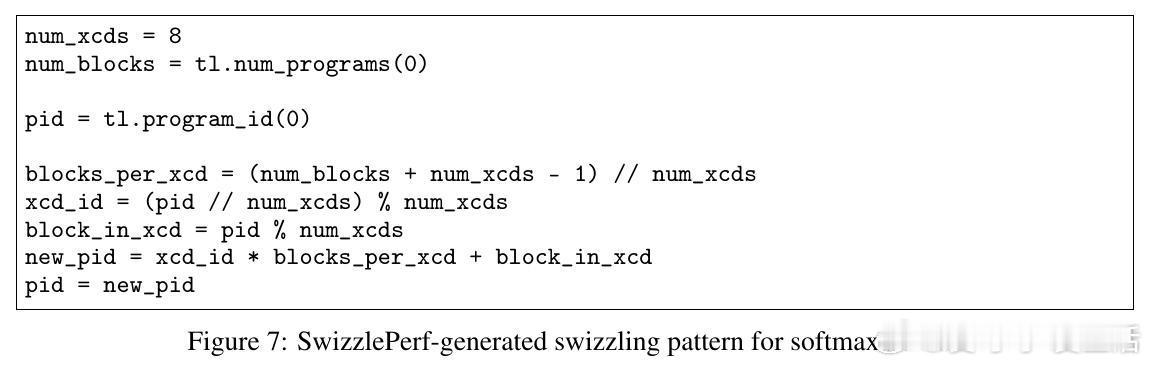

• Swizzling通过重新映射GPU工作组ID,实现数据与计算任务在芯片多个加速复杂体(XCD)间的合理布局,最大化局部L2缓存命中率,显著提升数据重用和访问局部性。

• 在GEMM案例中,SwizzlePerf仅用5分钟即找到与资深工程师两周努力相当的硬件特定swizzling模式,且包含额外边界条件处理,展现更强泛化能力。

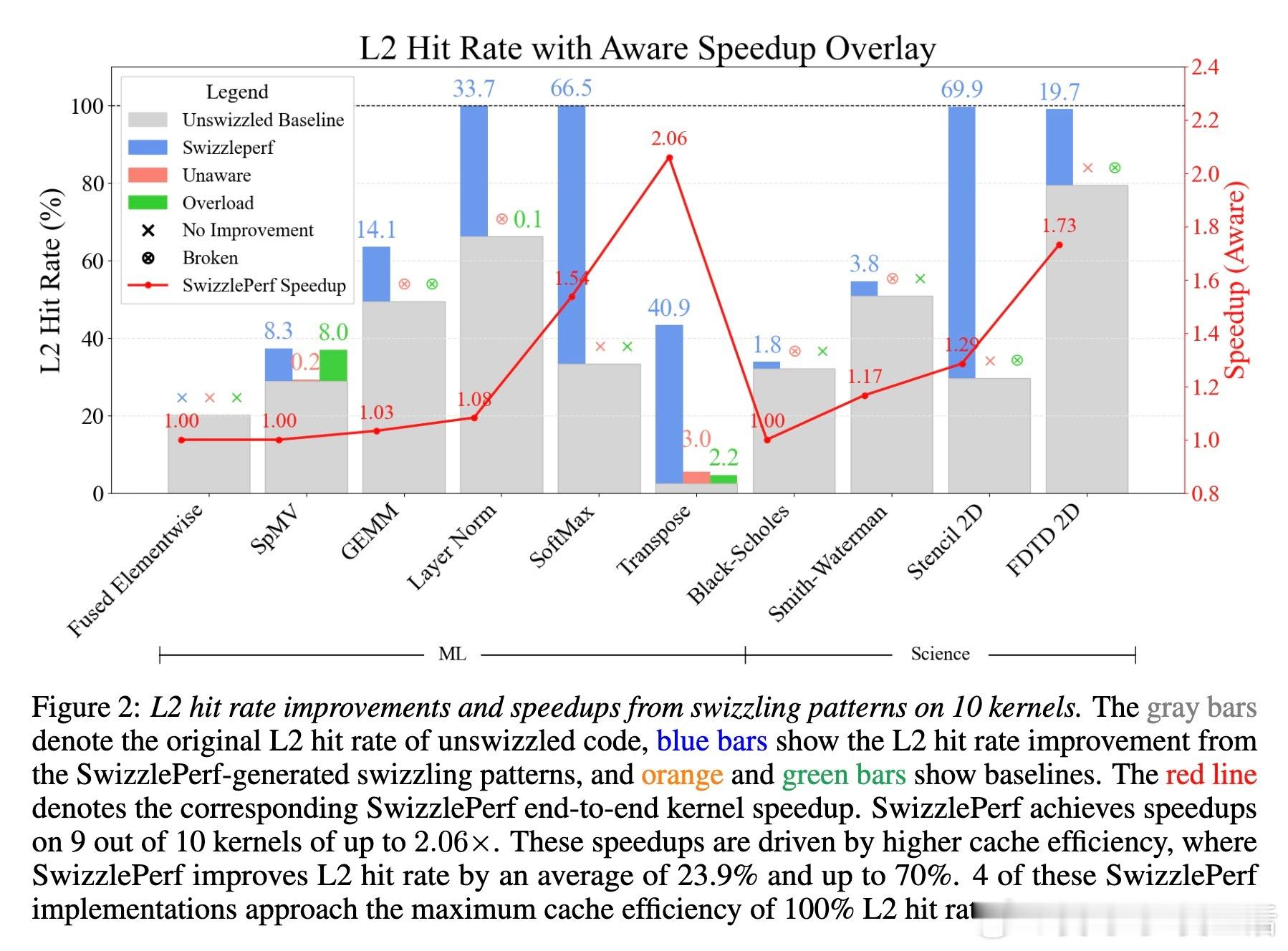

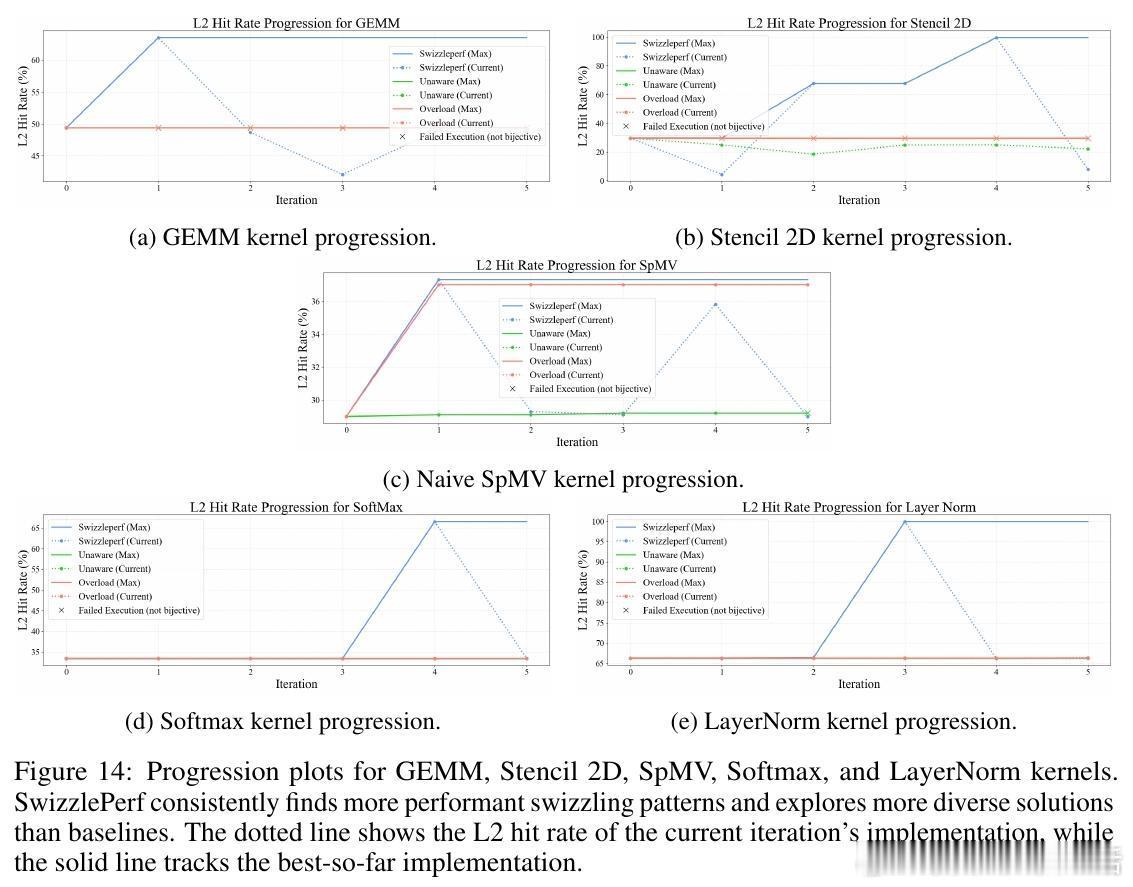

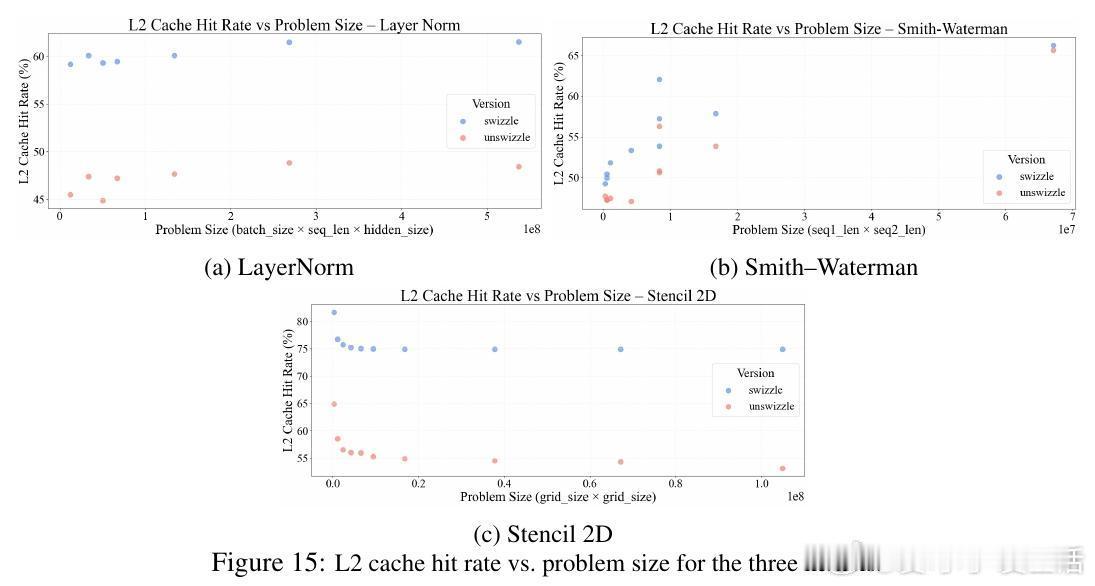

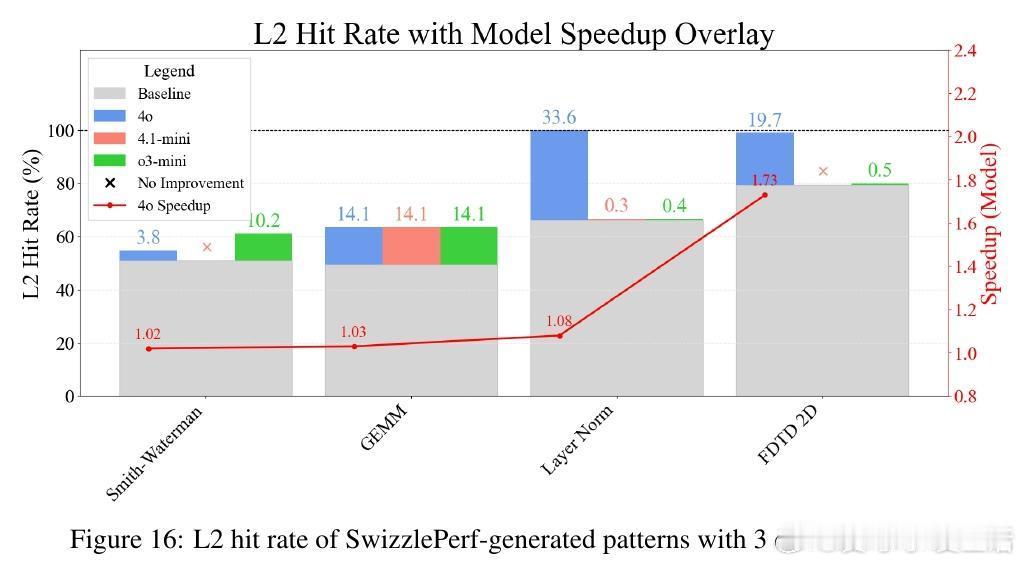

• 在涵盖6个机器学习及4个科学计算内核的测试中,SwizzlePerf为9个内核生成的swizzling策略带来平均1.29×加速,最高达2.06×,L2缓存命中率提升最高70%,4个内核命中率几近100%,极大提升缓存效率。

• 对比基础的无硬件感知方法和硬件信息过载方法,SwizzlePerf实现了更稳定、针对性强的优化,避免无效探索与错误映射。

• SwizzlePerf利用硬件感知上下文及瓶颈指标(如L2命中率)引导多轮迭代优化,持续反思前次结果,探索多样化映射方案,确保优化策略对不同问题规模和架构保持鲁棒。

• 不同LLM模型在不同内核优化中表现不一,表明硬件感知优化需结合模型、任务及硬件特性灵活选型。

• 未来方向包括引入多模态硬件信息(如可视化模式)、扩展至功耗优化,探究硬件感知对能效的潜在提升。

心得:

1. 明确的硬件上下文使LLM不再盲目搜索,而是精准聚焦于与硬件瓶颈相关的优化空间,显著加快收敛速度。

2. 静态的调度映射(swizzling)虽简单却极为有效,合理布局计算任务能极大降低跨芯片通信和缓存冲突,提升整体性能。

3. 硬件感知不仅提升性能,还间接优化能耗,为未来绿色计算提供了新路径。

了解详情🔗 arxiv.org/abs/2508.20258

GPU优化大型语言模型硬件感知性能工程高性能计算机器学习