7月2日,在智谱开放平台产业生态大会上,智谱宣布获浦东创投集团和张江集团10亿元战略投资,并于近期完成首笔交割。

在主题演讲中,智谱CEO张鹏发布了智谱携手生态伙伴迈向AGI的两项最新成果:一是开源发布新一代通用视觉语言模型GLM-4.1V-Thinking,以推理能力为核心突破,刷新10B级别多模态模型性能上限;二是MaaS全新上线Agent聚合平台「应用空间」,全面激活行业场景中的AI能力,联动Z基金启动Agent开拓者数亿元专项扶持计划。

全新发布:GLM-4.1V-Thinking

今天,智谱正式发布并开源视觉语言大模型GLM-4.1V-Thinking,标志着GLM系列视觉模型实现从感知走向认知的关键跃迁。

GLM-4.1V-Thinking是一款支持图像、视频、文档等多模态输入的通用推理型大模型,专为复杂认知任务设计。它在GLM-4V架构基础上引入“思维链推理机制(Chain-of-ThoughtReasoning)”,采用“课程采样强化学习策略(RLCS,ReinforcementLearningwithCurriculumSampling)”,系统性提升模型跨模态因果推理能力与稳定性。

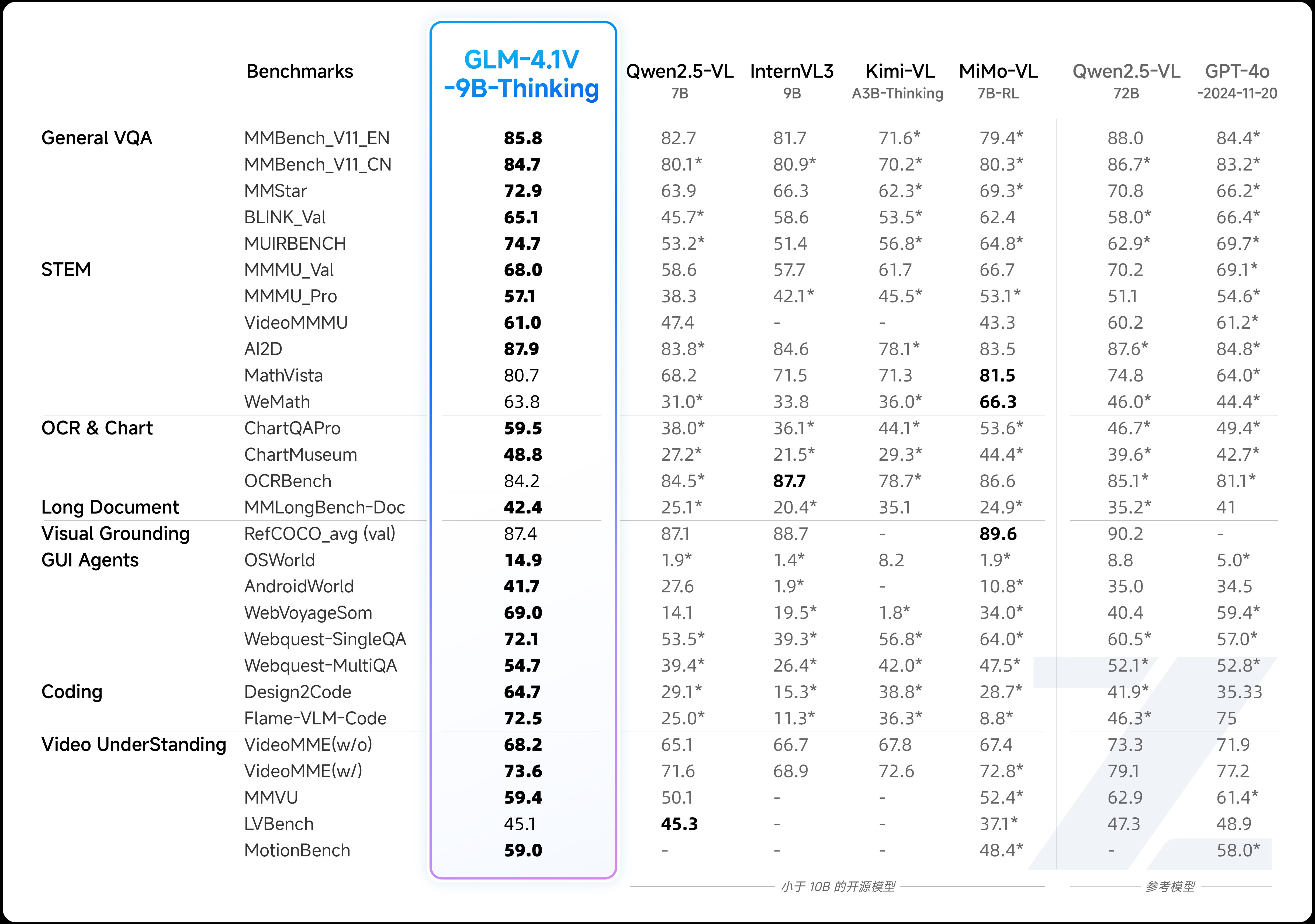

其轻量版GLM-4.1V-9B-Thinking模型参数控制在10B级别,在兼顾部署效率的同时实现性能突破。该模型在MMStar、MMMU-Pro、ChartQAPro、OSWorld等28项权威评测中,有23项达成10B级模型的最佳成绩,其中18项更是持平或超越参数量高达72B的Qwen-2.5-VL,充分展现了小体积模型的极限性能潜力。

模型特别在以下任务中表现卓越,展示出高度的通用性与稳健性:

图文理解(ImageGeneral):精准识别并综合分析图像与文本信息;

数学与科学推理(Math&Science):支持持复杂题解、多步演绎与公式理解;

视频理解(Video):具备时序分析与事件逻辑建模能力;

GUI与网页智能体任务(UI2Code、Agent):理解界面结构,辅助自动化操作;

视觉锚定与实体定位(Grounding):语言与图像区域精准对齐,提升人机交互可控性。

目前,GLM-4.1V-9B-Thinking已在HuggingFace与魔搭社区同步开源。包含两个模型,分别是GLM-4.1V-9B-Base基座模型,希望能够帮助更多研究者探索视觉语言模型的能力边界作;GLM-4.1V-9B-Thinking,具备深度思考和推理能力的模型,正常使用和体验,均为这一模型。

智谱在智谱开放平台上线GLM-4.1V-Thinking-FlashAPI,免费。

在面向科学研究、教育、自主Agent及多模态助手等更复杂现实世界应用时,补足推理能力的GLM-4.1V-Thinking,真正解决开放式、信息丰富的千行百业的场景问题。如长视频理解、图像问答、学科解题、文字识别、文档解读、Grounding、GUIAgent和代码生成。

GLM-4.1V-Thinking代表了通向通用多模态推理的重要一步。在接下来的工作中,智谱将通过更优的奖励模型、更好的RL算法进一步优化GLM-4.1V-Thinking系列模型;同时,智谱也将探索视觉与语言模态如何相互强化,这可能为提升通用推理能力带来重大突破。

MaaS应用空间:面向千行百业的AI生态市场

今天,智谱推出全新生态平台「Agent应用空间」,并开启「Agents开拓者计划」,投入数亿资金,全方位扶持AIAgents创业团队。

「Agent应用空间」是一个面向企业客户和开发者的AIAgent能力聚合平台,优秀开发者与企业用户。平台汇聚丰富的Agent应用与模型插件(MCP),提供开箱即用、灵活编排的组件服务和Agents应用,帮助企业无需自建大模型团队,即可低门槛接入成熟、安全、可控的Agent能力。

「Agent应用空间」提供一站式开发工具链、完整的模型调用接口与灵活的应用组合机制,是“AI原生化”升级的重要起点。正如智谱CEO张鹏所言:“AI的未来,不仅是模型性能的比拼,更是生产范式的重构。在这个时代,每一位开发者、设计者、创业者,都是智能生态的共同缔造者。”

希望在智谱的基座模型、多模态模型和MaaS平台的支持下,每个人都可以用AI表达想法、生成内容、构建应用,甚至创建一家AI原生公司。这是一场关于智能的共同创作,也是一场属于开发者的未来革命。